Ein maschinelles Bildverarbeitungssystem ist ein technisches System, das Maschinen verwendet, um das menschliche Auge zu ersetzen, um Messungen, Identifizierung und Beurteilung durchzuführen. Es ist einer der wichtigsten Zweige der Informatik. Das System integriert multidisziplinäre Technologien wie Optik, Mechanik, Elektronik sowie Computersoftware und -hardware und umfasst viele Bereiche wie Bildverarbeitung, Mustererkennung, künstliche Intelligenz, Signalverarbeitung und optisch-mechanische Integration.

Mit der rasanten Entwicklung von Schlüsseltechnologien wie Bildverarbeitung und Mustererkennung haben auch die Tiefe und Breite der Bildverarbeitungsanwendungen weiter zugenommen.

In den letzten Jahren hat sich die Bildverarbeitungstechnologie, angetrieben durch intelligente Fertigung und industrielle Automatisierung, in Richtung höherer Präzision und Intelligenz weiterentwickelt. Im Vergleich zur herkömmlichen zweidimensionalen Bildverarbeitung wandeln sich Forschung und Anwendung im Bereich der industriellen Bildverarbeitung schrittweise zur visuellen 3D-Inspektionstechnologie um und werden in großem Maßstab in Szenarien wie der Schweißnahtprüfung, der Teilesortierung und der Blechvermessung eingesetzt.

Man kann sagen, dass sich die maschinelle Bildverarbeitung von der „zweidimensionalen Erkennung“ zur „dreidimensionalen Wahrnehmung“ entwickelt.

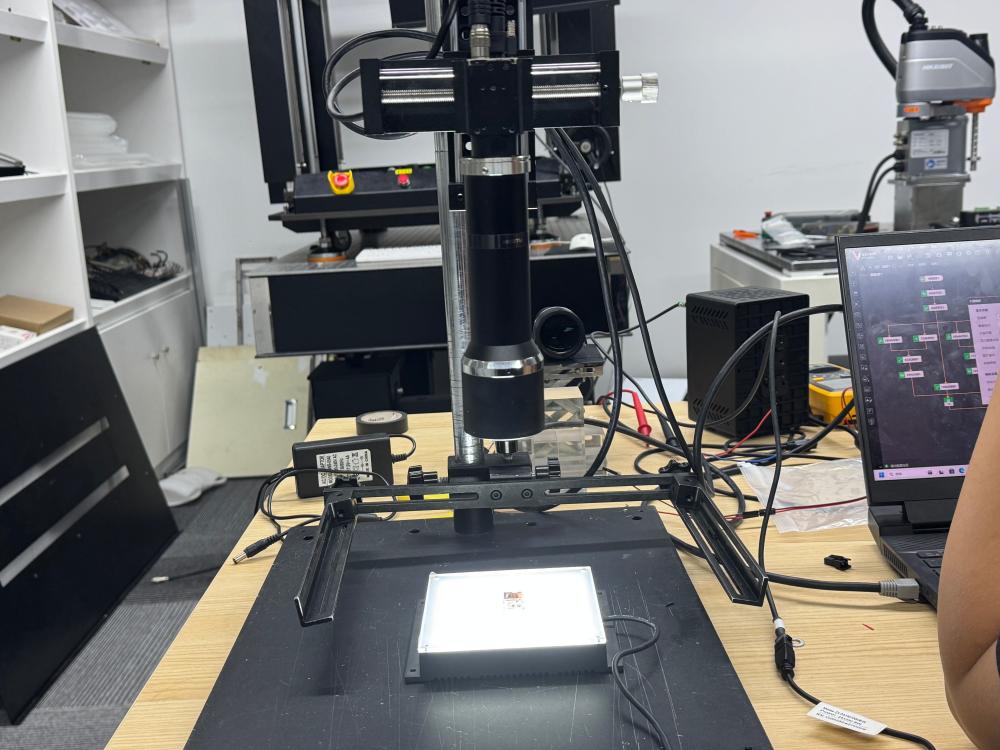

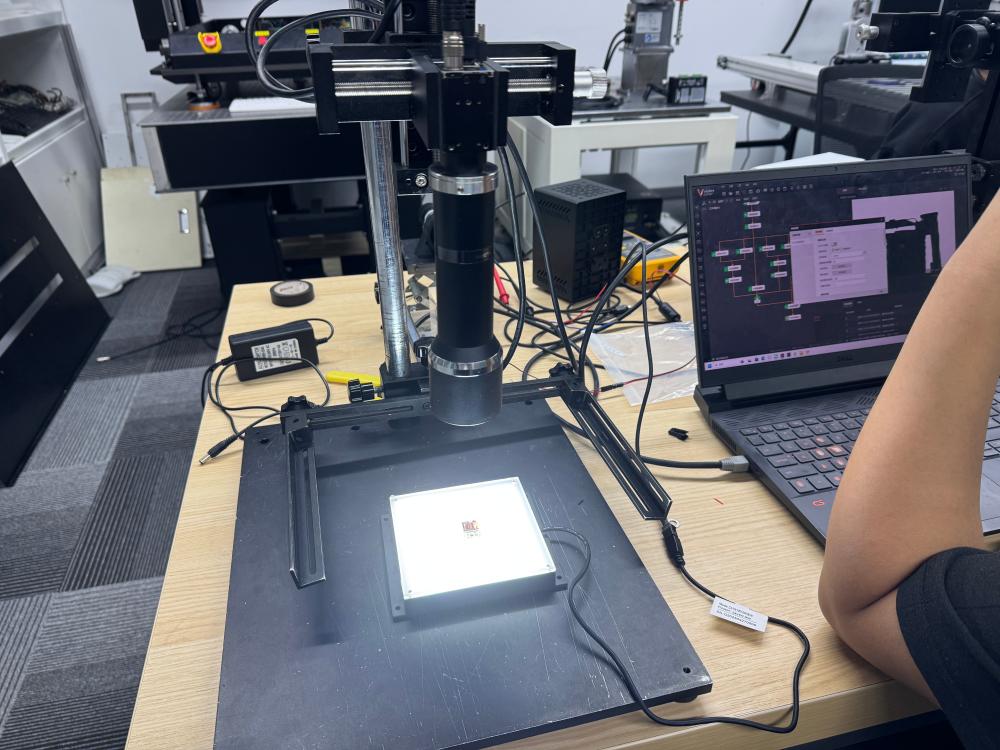

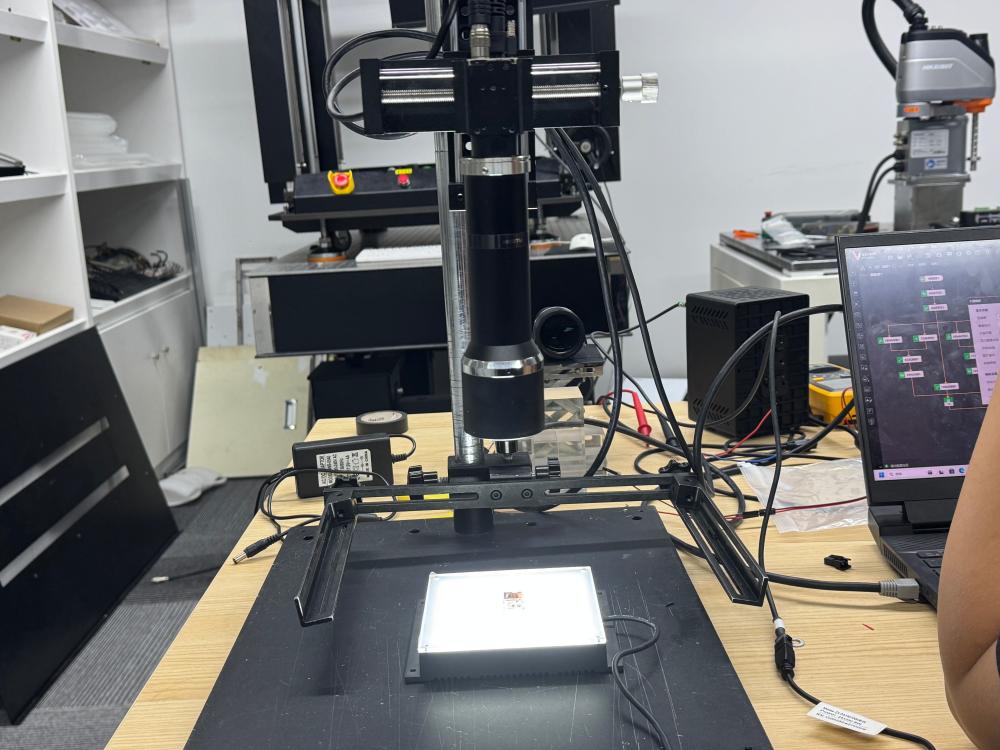

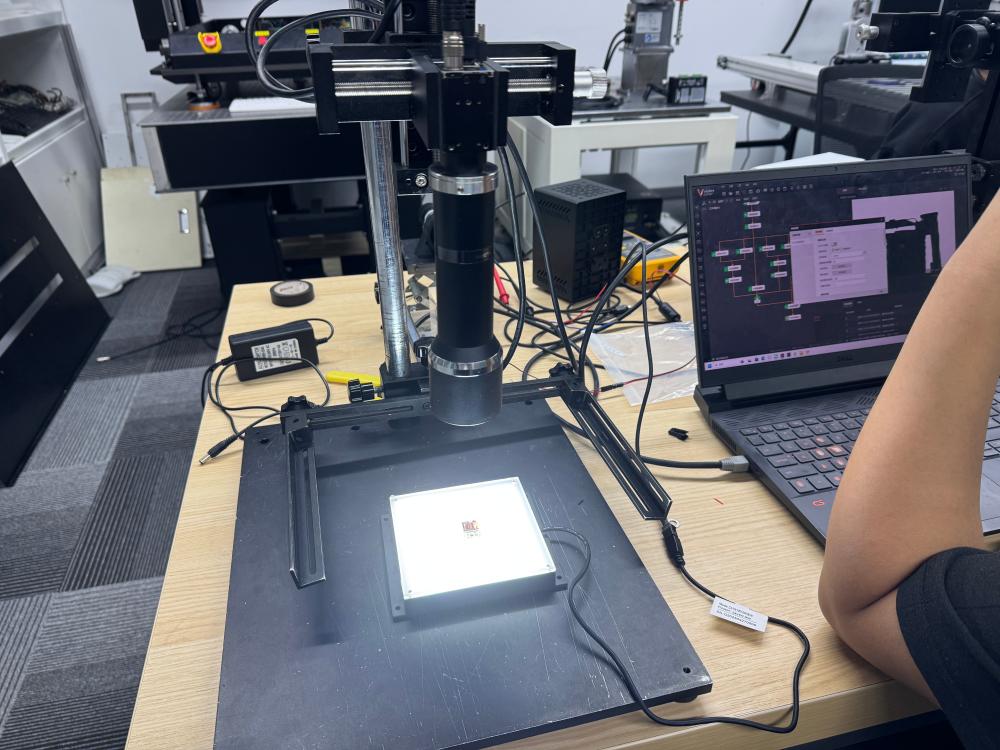

Aus Sicht der Systemzusammensetzung umfasst ein vollständiges Bildverarbeitungssystem normalerweise ein Beleuchtungssystem, ein Industrieobjektiv, ein Kamerasystem und ein Bildverarbeitungssystem. In praktischen Anwendungen ist es notwendig, Schlüsselfaktoren wie die Betriebsgeschwindigkeit des Systems und die Bildverarbeitungseffizienz, den Kameratyp (Farbe oder Schwarzweiß), ob das Inspektionsziel eine Größenmessung oder Fehlererkennung ist, den erforderlichen Sichtfeldbereich, die Auflösung und den Bildkontrast entsprechend den spezifischen Inspektionsanforderungen umfassend zu berücksichtigen, um eine stabile und effiziente visuelle Inspektionslösung aufzubauen.

visuellen SystemsDie Struktur des

Hardware-Systemdesign

Der Hardware-Teil des Bildverarbeitungssystems besteht hauptsächlich aus Industrieobjektiven, Industriekameras, Bilderfassungskarten, Ein-/Ausgabeeinheiten und Steuergeräten.

Die Gesamtleistung des Bildverarbeitungssystems hängt nicht nur von der Qualität der Kamerapixel und der Hardware selbst ab, sondern, was noch wichtiger ist, von der angemessenen Abstimmung und Zusammenarbeit zwischen den verschiedenen Hardwaremodulen. Beispielsweise wirken sich die Abstimmung von Objektiv- und Kameraauflösung sowie die Kompatibilität von Aufnahmekarte und Datenschnittstelle direkt auf die Bildqualität und Betriebsstabilität des Systems aus.

Daher ist ein leistungsstarkes Bildverarbeitungssystem untrennbar mit einer umfassenden Berücksichtigung der Hardwareauswahl, der Systemstruktur und der Anwendungsszenarien verbunden.

Design von Softwaresystemen

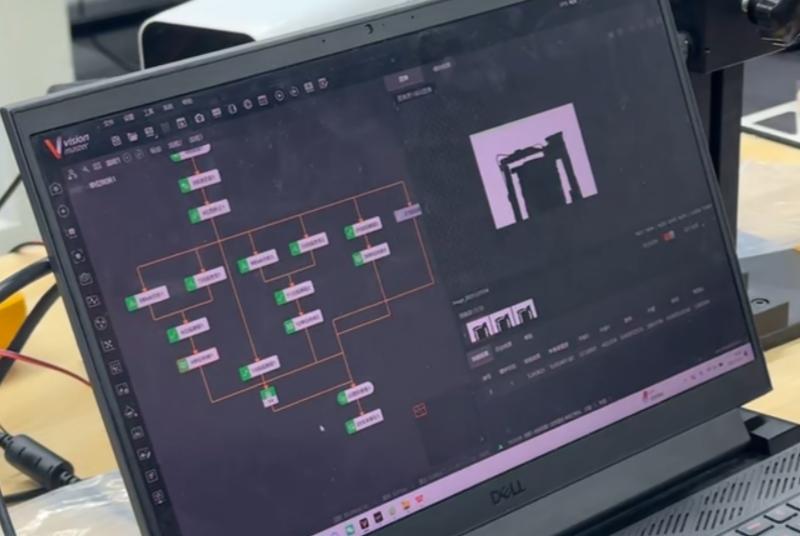

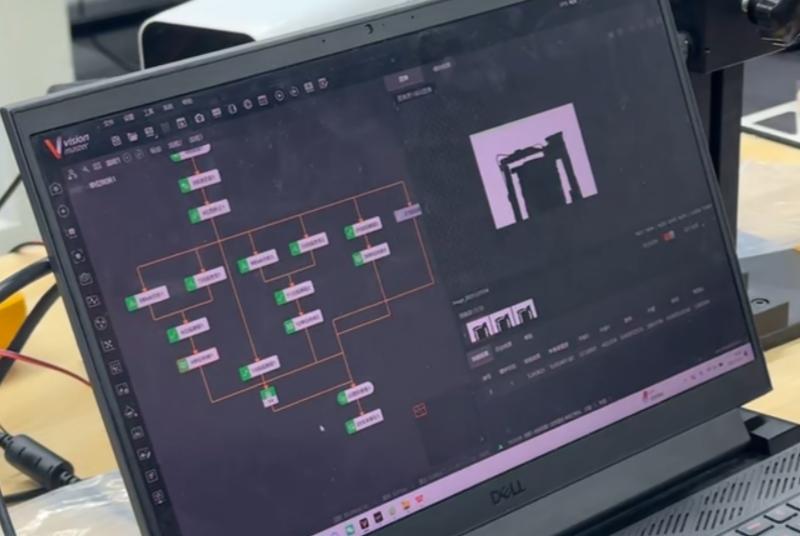

Das Softwaredesign des visuellen Systems ist eines der Kernglieder des Gesamtsystems und weist eine hohe technische Komplexität auf. Während des Softwareentwicklungsprozesses müssen wir nicht nur auf die Optimierung der Programmstruktur und der Betriebseffizienz achten, sondern uns auch auf die Genauigkeit, Realisierbarkeit und stabile Leistung des Algorithmus in tatsächlichen Szenarien konzentrieren.

Nach Fertigstellung des Softwaresystems muss seine Robustheit vollständig getestet und kontinuierlich optimiert werden, um sicherzustellen, dass das System in komplexen externen Umgebungen wie Beleuchtungsänderungen, Hintergrundstörungen und Zielunterschieden eine stabile und zuverlässige Erkennungsleistung aufrechterhalten kann.

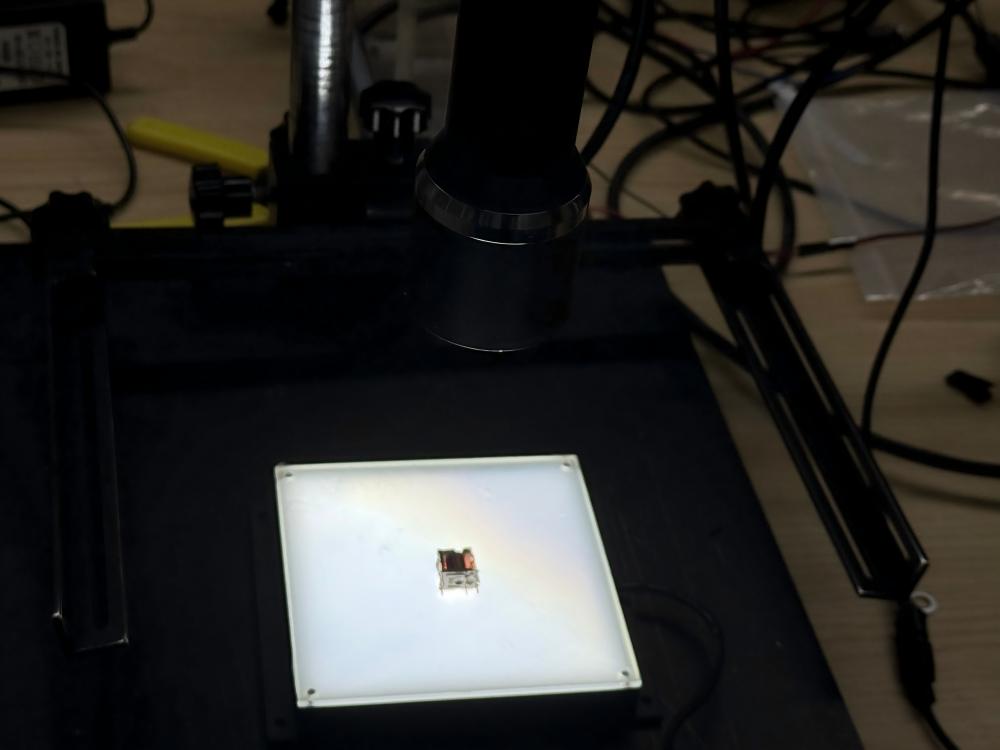

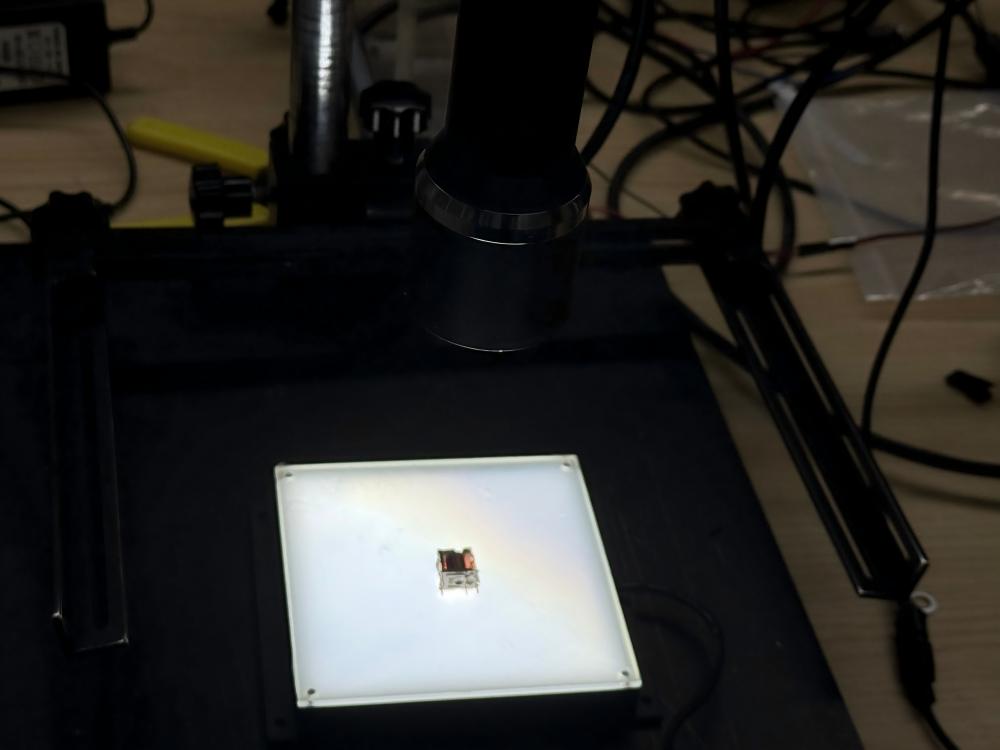

Bei Roboter-Vision-Anwendungen besteht das System normalerweise aus zwei Teilen: einem Bilderfassungsmodul und einem Vision-Verarbeitungsmodul.

Das Bilderfassungsmodul umfasst unter anderem ein Beleuchtungssystem, einen visuellen Sensor, einen Analog-Digital-Wandler (A/D), einen Bildspeicher usw. und wird zum Sammeln zweidimensionaler Bildinformationen in der Umgebung verwendet.

Das Roboter-Vision-System erhält Bilddaten über den visuellen Sensor und analysiert, identifiziert und versteht sie dann durch den Vision-Prozessor und wandelt die Verarbeitungsergebnisse in ausführbare Steueranweisungen um, sodass der Roboter das Zielobjekt genau identifizieren und seine räumliche Position bestimmen kann, wodurch Aufgaben wie Positionierung, Greifen und Montage erledigt werden.

Hochpräzise berührungslose Messlösung

Der spektrale konfokale Sensor basiert auf dem Prinzip der Weißlichtdispersion und fokussiert monochromatisches Licht unterschiedlicher Wellenlängen durch ein spezielles optisches System auf unterschiedliche Fokuspositionen. Das System kann den Abstand zwischen dem Objekt und dem Sensor anhand der Wellenlängeninformationen des von der Oberfläche des gemessenen Objekts reflektierten Lichts genau berechnen.

Diese Messmethode wird nicht durch die Intensität des reflektierten Lichts beeinflusst, ist für fast alle Materialien geeignet und kann eine hochpräzise, hochstabile berührungslose Messung erreichen. Mit einem einzigen Scan kann die vollständige oder teilweise 3D-Topographie der Oberfläche des Messobjekts erfasst werden, was erhebliche Vorteile wie hohe Präzision, hohe Geschwindigkeit und starke Stabilität bietet.

Im Vergleich zu herkömmlichen Lasererkennungsverfahren schneidet die spektrale Konfokaltechnologie besonders gut bei der Erkennung transparenter Objekte, stark reflektierender Spiegel und stark lichtabsorbierender Materialien ab. Es wird häufig in Online-Erkennungsszenarien in Branchen wie 3C-Elektronik, Halbleitern, Lithium-Batterie-Neuenergie und Präzisionshardware eingesetzt.

3D-Messlösung in Industriequalität

Die Lasertriangulation ist eine ausgereifte dreidimensionale Messmethode, die in Branchen wie Holz, Gummi, Reifen, Autoteilen, Metall und Gusseisen weit verbreitet ist. Es eignet sich auch für groß angelegte Inspektionsszenarien wie Straßenoberflächen.

Diese Technologie erzeugt 3D-Punktwolkendaten, indem strukturiertes Laserlicht auf die Oberfläche eines Objekts projiziert wird. Die Kamera erfasst das Laserlinienprofil und berechnet Höheninformationen. In praktischen Anwendungen bewegt sich das Messobjekt normalerweise unter dem Sensor, und mehrere Konturabschnitte werden kontinuierlich gesammelt und zusammengefügt, um schließlich ein vollständiges dreidimensionales Bild zu erzeugen.

Der Installationswinkel zwischen Laser und Kamera hat einen wichtigen Einfluss auf die Messgenauigkeit und Systemstabilität. Eine Vergrößerung des Winkels trägt zur Verbesserung der Höhenauflösung bei, während eine Verkleinerung des Winkels zur Verbesserung der Gesamtstabilität beiträgt. In Kombination mit ausgereiften Softwarealgorithmen konnte mit dieser Technologie eine effiziente und zuverlässige 3D-Datenverarbeitung und -analyse erreicht werden.

3D-Stereo-Vision-Kameralösung

Die 3D-Stereo-Vision-Kamera basiert auf dem Prinzip des binokularen Sehens ähnlich dem des menschlichen Auges. Es erfasst Bilder aus unterschiedlichen Blickwinkeln über zwei Kameras und berechnet anhand der Parallaxeninformationen die Tiefendaten des Objekts.

In tatsächlichen industriellen Anwendungen wird normalerweise die zufällige Texturprojektion kombiniert, um die charakteristischen Informationen der Oberfläche des gemessenen Objekts zu verbessern und dadurch die Bildanpassungsgenauigkeit zu verbessern. Diese Technologie wird häufig in Szenarien wie Roboterführung, Montagepositionierung und System-Debugging eingesetzt und hat eine gute Anpassungsfähigkeit bei dynamischer Erkennung und flexiblen Produktionsumgebungen bewiesen.

Schnelle räumliche Positionierung

ToF-Kameras berechnen die Zielentfernung, indem sie Infrarotlichtimpulse aussenden und die Zeit messen, die das reflektierte Licht benötigt, um zum Sensor zurückzukehren, ähnlich wie bei der Radarentfernungsmessung.

Die frühe ToF-Technologie war durch Auflösung und Messgenauigkeit begrenzt, was es schwierig machte, die Erkennungsanforderungen auf industrieller Ebene zu erfüllen. Mit der Weiterentwicklung der Technologie sind Megapixel-ToF-Kameras entstanden, die nach und nach in Anwendungen wie der 3D-Objekterkennung, dem Be- und Entladen von Robotern sowie dem Be- und Entladen von Paletten gefördert werden.

Es ist zu beachten, dass die ToF-Technologie besser für die Zielerkennung und räumliche Positionierung geeignet ist und nicht für hochpräzise Dimensionsmessszenarien geeignet ist.

Die Rolle von Software in der 3D-Vision

existieren In einem 3D-Bildverarbeitungssystem entspricht die Bildverarbeitungs- und Analysesoftware dem „Gehirn“ des Systems.

Die herkömmliche visuelle Inspektion stützt sich stark auf die Regelprogrammierung und erledigt Inspektionsaufgaben durch Merkmalsvergleich und Schwellenwertbeurteilung. Da die Komplexität der Anwendungsszenarien immer weiter zunimmt, werden Deep Learning und künstliche neuronale Netze (KNN) nach und nach zu Mainstream-Lösungen.

Künstliche neuronale Netze bestehen aus einer großen Anzahl miteinander verbundener „Neuronen“, und ihre Verbindungsgewichte können entsprechend den Trainingsdaten kontinuierlich angepasst werden, wodurch autonomes Lernen und Merkmalsextraktion erreicht werden. Unter dem Deep-Learning-Framework muss das System komplexe Bildmerkmale nicht manuell definieren. Es müssen lediglich Originalbilddaten eingegeben werden, um die Merkmalsextraktion, -klassifizierung und -beurteilung automatisch abzuschließen, was eine stärkere Anpassungsfähigkeit und Robustheit in komplexen Industrieumgebungen zeigt.

Mit der kontinuierlichen Reife der 3D-Bildgebungstechnologie, der Punktwolkenverarbeitungsalgorithmen und der künstlichen Intelligenz entwickelt sich die maschinelle Bildverarbeitung in Richtung höherer Präzision, stärkerer Intelligenz und breiterer Anwendungsszenarien.

Die Kombination aus 3D-Bildverarbeitung und Deep Learning von Zhixiang Vision wird die Grenzen der industriellen Inspektion weiter erweitern und zuverlässigeren technischen Support für intelligente Fertigungs- und Automatisierungs-Upgrades bieten. Die Bildverarbeitungsbranche ist voller Erwartungen für die Zukunft, warten wir ab.